Claude, la IA que capturó a Maduro y ahora enfrenta el veto de Trump por seguridad nacional

El modelo de inteligencia artificial Claude, desarrollado por Anthropic, se encuentra en el centro de una controversia que trasciende lo tecnológico para adentrarse en el ámbito geopolítico y de seguridad. Según información preliminar, esta herramienta habría participado en operaciones que llevaron a la captura de Nicolás Maduro, aunque se desconocen detalles específicos sobre el alcance y la naturaleza de dicha colaboración. Actualmente, la administración del presidente Donald Trump ha catalogado a Anthropic como un riesgo para la seguridad nacional, vetando el uso de Claude dentro del gobierno federal. Este movimiento abre un profundo debate sobre el control de tecnologías avanzadas, su potencial aplicación militar y los límites de la innovación privada frente a los intereses del Estado.

De herramienta estratégica a amenaza percibida

La trayectoria de Claude, el modelo de inteligencia artificial de Anthropic, ilustra la dualidad inherente a las tecnologías de vanguardia. Inicialmente desplegado como una plataforma de capacidades generales, su sofisticación lo llevó a ser considerado para aplicaciones de alto impacto. Reportes indican que su arquitectura fue utilizada en operaciones de inteligencia que culminaron con la captura del líder venezolano Nicolás Maduro, marcando un hito en la integración de IA en misiones de seguridad complejas. Este éxito, sin embargo, sembró las semillas de la actual confrontación, al demostrar el poder transformador –y potencialmente disruptivo– de la herramienta en escenarios de seguridad nacional.

La doctrina Trump y el nuevo paradigma de seguridad

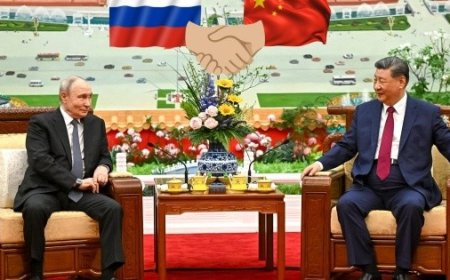

La administración del presidente Donald Trump ha adoptado una postura decididamente intervencionista respecto a tecnologías consideradas críticas. La catalogación de Anthropic como un riesgo para la seguridad nacional y el posterior veto a Claude dentro del gobierno federal no son medidas aisladas. Se enmarcan en una visión más amplia, donde el control sobre innovaciones con aplicaciones militares o de inteligencia se considera un pilar de la soberanía. Esta postura ha sido articulada por figuras como el nuevo secretario de Seguridad, Markwayne Mullin, quien reemplazó a Kristi Noem tras su destitución por Trump, y refleja una creciente preocupación por la dependencia de soluciones desarrolladas por el sector privado sin supervisión estatal directa.

El precedente peligroso: innovación privada vs. control estatal

La decisión de vetar a Claude establece un peligroso precedente al invocar la seguridad nacional para imponer restricciones al sector tecnológico privado. El debate subyacente cuestiona hasta qué punto el gobierno puede forzar a empresas a ceder el control de sus innovaciones o limitar su desarrollo en nombre del interés público. Expertos advierten que este enfoque podría sofocar la competitividad y la innovación en un campo donde Estados Unidos ha sido líder. Por otro lado, proponentes de la medida argumentan que el poder de modelos como Claude, demostrado en escenarios reales como la captura de Maduro, es demasiado significativo como para dejarlo fuera del ámbito de regulación y supervisión gubernamental estricta.

El contexto geopolítico y la revolución militar en ciernes

Esta polémica ocurre en un momento de rápida evolución del panorama de seguridad global. Conflictos como la guerra entre Rusia y Ucrania han impulsado una revolución tecnológica militar, donde drones relativamente baratos desafían sistemas de defensa costosos. Países del Golfo y Estados Unidos están observando y posiblemente adoptando tácticas y tecnologías ucranianas para contrarrestar amenazas como los drones Shahed de Irán. En este escenario, el control de inteligencia artificial avanzada se convierte en un activo estratégico de primer orden. La administración Trump, en su búsqueda por doblegar lo que percibe como radicalismo islámico y reconfigurar Oriente Medio, parece considerar que tecnologías como Claude deben ser instrumentos de estado, no commodities en el mercado.

El futuro incierto de la IA en la seguridad nacional

El caso de Claude deja al descubierto tensiones fundamentales que definirán el futuro de la inteligencia artificial. Por un lado, está el impulso innovador del sector privado, capaz de producir avances rápidos y aplicaciones imprevistas. Por el otro, la necesidad del Estado de garantizar la seguridad, mantener ventajas estratégicas y prevenir usos maliciosos de tecnologías de doble propósito. La disputa entre Anthropic y la administración Trump es probablemente el primer capítulo de una serie de conflictos similares. Su resolución sentará las bases para un nuevo marco regulatorio y operativo que balancee la promesa de la innovación con los imperativos de la seguridad en una era de competencia tecnológica global acelerada.

Con información de El Tiempo

Síguenos en canales

Contenido exclusivo, noticias y más